В практике аутсорс-разработки мы часто видим одну и ту же драму. На этапе стейджинга все выглядит очень неплохо, в отчетах QA прописано, что система стабильна при 10k RPS, графики ровные, latency в пределах нормы, отчёт зелёный. Но стоит маркетингу запустить кампанию или крупному энтерпрайз-клиенту провести онбординг сотрудников, как сервис превращается в тыкву. А полночь (т.е. ожидаемая серьезная нагрузка) даже еще не наступила.

Мы уже говорили о том, как все происходит и самое дурацкое в этой ситуации – ложное чувство безопасности. Если ваши нагрузочные тесты пройдены, а система всё равно легла на 30% от заявленной мощности, значит, вы тестировали сферического коня в вакууме (погуглите, хороший анекдот).

Давайте посмотрим, обо что спотыкается SaaS и чего это он все-таки падает, раз отчеты так хороши.

Стерильные сценарии vs потока сознания юзера

Типичный нагрузочный скрипт (на JMeter или k6) как дисциплинированный Безупречный под рукой Дейнерис. Он делает паузы (think time), идет по «золотому пути» и закрывает сессию. Но это не Игра престолов, а вполне реальная жизнь, поэтому тут всё иначе:

- Эффект паники (Retry Storm). Если API замедлился до 3 секунд, пользователь уже нервничает и не ждет. Он нажимает «Обновить» или кликает на кнопку «Купить» пять раз подряд. Вместо одного тяжелого запроса база получает пять одинаковых. А через пару секунд ещё пять, потому что юзер решил, что кнопка не нажалась. В результате нагрузку создаёт не количество людей, а их нетерпеливость, паника.

- Вкладки-убийцы. Мы, как современные пользователи SaaS, держим иногда открытыми 10-15 вкладок сервиса. Каждая из них может слать фоновые запросы (polling, уведомления, обновление статусов). В итоге 1000 живых людей за ПК генерируют нагрузку как 15 000 виртуальных пользователей.

Новый «черный лебедь», или нашествие AI-агентов

В 2026 году главной угрозой стали не люди, а AI-агенты и RAG-системы ваших же клиентов. Одна моя знакомая любит фразу «насколько это плохо, что аж хорошо». Так вот в отношении ИИ-агентов вполне можно ее использовать наоборот. Они настолько хороши, что аж плохо. Не согласны?

Если раньше нагрузка была человекочитаемой, то теперь клиент может подключить к вашему API своего умного помощника ИИ, который начнет выкачивать данные для обучения или индексации…

Но! Бот не делает пауз. Вот вам проблема. Он обходит кэш, подставляя уникальные параметры в каждый запрос. И в результате ваш кэш фактически вымывается за секунды, и 90% трафика летит напрямую в БД. Без жесткого Rate Limiting на уровне API Gateway такие агенты выкашивают SaaS быстрее любого DDoS (о безопасности ваших проектов писали тут).

Тренды и фишки из мира IT,

экспертные статьи и всё о тестировании.

Совет от ЛК. Проверьте свои User-Agent логи. Если там внезапно вырос трафик от python-requests или специфических AI-библиотек, это оно, нашествие агентов. Но будьте осторожны, так как продвинутые агенты умеют притворяться обычным Chrome, и тогда их приходится ловить уже по аномальной скорости и машинной последовательности запросов.

Архитектурные «бутылочные горлышки»

Даже если (не хочется никого задеть, но так бывает редко) код идеален, система упирается в физические и логические пределы.

База данных все равно что проклятие Multi-tenancy

В SaaS данные всех клиентов часто лежат в одной базе данных. Если один крупный клиент запустит свой тяжелый годовой отчет, что мы увидим? СУБД начнет читать миллионы строк, пересчитывать агрегаты, строить временные таблицы и тут умирают все остальные клиенты, даже те, кто просто зашел почитать профиль. Тяжелый запрос захватывает ресурсы или ставит эксклюзивные блокировки на таблицы, через которые пытаются пройти другие пользователи. Просто потому, что данные всех клиентов лежат в одной БД, начинается тормозуха.

Такие проблемы, как мы писали в прошлый раз, решаются изоляцией ресурсов (Resource Quotas) на уровне БД или шардированием по клиентам.

Точка насыщения и Scaling Lag

Облачный автоскейлинг (AWS, Yandex Cloud) смахивает на попытку догнать уходящий поезд. Это не волшебная палочка, а инерционная система. Новым мощностям нужно время на прогрев, а вашим пользователям нужен результат здесь и сейчас.

- Scaling Lag. Новым подам в Kubernetes нужно max 2 минуты, чтобы подняться и «прогреться». Если всплеск нагрузки произошел за 20 секунд, подмога просто не успеет.

- Connection Pool. Допустим, вы добавили 10 новых серверов приложений, но забыли, что база данных принимает только 500 одновременных соединений. Новые серверы просто выбьют старые и система ляжет окончательно.

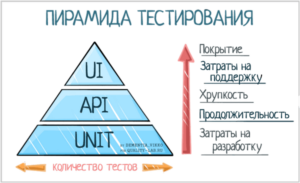

Почему тесты не показывают деградацию?

Большинство команд совершает три критические ошибки при анализе отчетов:

- Ложь среднего арифметического. Среднее время ответа почти ничего не говорит о реальном опыте пользователей. Если оно 200 мс, это звучит отлично. Но смотреть нужно на P991. Если он 15 секунд, значит каждый сотый пользователь просто сидит и смотрит на спиннер.

- Отсутствие Soak-тестирования, то есть тестирования выносливости. Короткий тест на 15 минут не покажет утечки памяти или фрагментацию индексов. Настоящие проблемы в SaaS выплывают на поверхность через 4-6 часов стабильно высокой нагрузки.

- Синтетические данные. Тестировать на базе в 1 ГБ, когда в проде 1 ТБ, бессмысленно. На больших объемах планировщик SQL-запросов будет вести себя иначе, а Join-ы, которые летали в тесте, превратятся в бесконечное чтение с диска.

Как ЛК защищает бизнес-метрики клиентов

Мы в аутсорс-разработке смотрим на нагрузку глазами бизнеса. Падение сервиса не выглядит чисто как какая-то 500-я ошибка (Internal Server Error). Бизнес остро чувствует ее, это потерянный LTV и сожженный рекламный бюджет.

Стек musthave-практик для 2026 года:

- Chaos Engineering. Мы принудительно «убиваем» микросервисы в нагрузочном контуре, чтобы проверить, работает ли Circuit Breaker (предохранитель)2, который не даст всей системе упасть за одним звеном.

- Graceful Degradation. Проектируем систему так, чтобы при пиках она отключала неважную, но приятную глазу пользователя, мишуру (аватарки, ленту рекомендаций), при этом сохраняла критический путь (оплату и запись данных).

- Observability 2.0. Мониторим не CPU/RAM, а бизнес-транзакции и длину очередей. Мы считываем симптомы усталости системы за 5 минут до того, как она упадет в глубокий обморок. Это дает нам время на маневр, а вашему бизнесу непрерывность.

Что в итоге?

В конечном счете, пользователю все равно, сколько у вас микросервисов и какой стек. Ему нужно, чтобы кнопка сработала здесь и сейчас. Наша задача как раз сделать так, чтобы красивые отчеты о тестировании не превращались в тыкву при первом серьезном вызове. SaaS в 2026 году должен быть адаптивным: уметь масштабироваться под AI-ботов, изолировать «шумных соседей» и сохранять лицо даже в условиях частичного отказа.

SaaS падает не от нехватки мощностей, как мы уже сказали. Можно бесконечно масштабировать API, но упереться в лимиты облачного провайдера или блокировки БД. Нагрузочное тестирование для нас – это своего рода поиск того самого кирпичика, который вылетит первым и лучше найти его в тестовом контуре, чем объясняться с клиентами во время сбоя в прод.

Если вам претит отчет для галочки и нужен реальный стресс-тест системы в условиях работы пользователя 2026 года, мы на связи.

- P99 (99-й перцентиль) – «детектор боли» самого несчастного пользователя. Пока среднее время ответа радует глаз отчетами, P99 показывает, сколько на самом деле ждут ваши самые активные клиенты в пиковые моменты. Игнорировать P99, значит сознательно соглашаться на отток 1% аудитории при каждом всплеске нагрузки ↩︎

- Circuit Breaker («Предохранитель») – паттерн в архитектуре, который автоматически изолирует проблемный участок системы. Если внешний сервис (например, оплата) начинает тормозить, предохранитель «размыкается» и мгновенно отдаёт ошибку или заглушку. Это не даёт всей системе зависнуть в ожидании ответа и сгореть под очередью запросов. ↩︎